Esta semana el panorama de la IA agentiva ha dado un cambio de fase. Seguimos buscando la optimización del silicio mientras presenciamos la nueva generación de frameworks que estandarizaran la delegación de tareas en el mundo real a escala masiva.

Suscríbete para juntos destapar las cajas negras y descubrir lo que ocultan.

// Top News

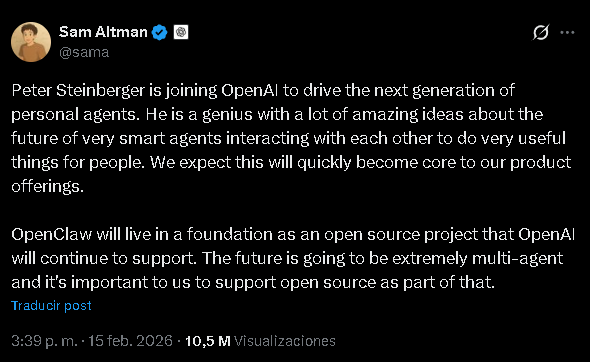

OpenClaw → OpenAI + Fundación Open Source

Hace pocas horas (15 de febrero), Sam Altman anunció que Peter Steinberger, creador del agente de IA viral OpenClaw (antes Clawdbot, luego Moltbot), se une a OpenAI para liderar “la próxima generación de agentes personales”.

OpenClaw se convierte en un proyecto open source independiente bajo una fundación respaldada por OpenAI.

¿Qué es OpenClaw y por qué importa?

OpenClaw es un framework de agentes autónomos que permite a usuarios finales delegar tareas del mundo real (gestionar email, reservar vuelos, check-ins, interactuar con aseguradoras, incluso participar en redes sociales de agentes) mediante interfaces conversacionales como WhatsApp o Telegram. Los usuarios descargan el código, lo conectan a modelos como GPT-4 o Claude, y tienen un “asistente personal que realmente hace cosas”.

Lanzado en noviembre de 2025 ya ha superado las 100,000 estrellas en GitHub y se corono como uno de los repos de más rápido crecimiento en la historia de la plataforma con 2 millones de usuarios en la primera semana de viralización.

En su blog post del 15 de febrero, Steinberger explicó que tuvo ofertas de Meta y OpenAI, y que aunque podría haber convertido OpenClaw en “una gran empresa”, eligió OpenAI porque su objetivo es “cambiar el mundo, no construir una gran compañía”.

“Lo que quiero es cambiar el mundo, no construir una gran empresa. Unirme a OpenAI es la forma más rápida de llevar esto a todos.”

Para un CTO o director técnico, esta es una señal clara: el talento top en agentic AI no está eligiendo el camino startup tradicional, sino posiciones estratégicas dentro de los labs de frontera donde pueden acelerar deployment a escala masiva.

¿Qué cambia para los usuarios y desarrolladores?

OpenClaw NO se cierra ni se vuelve propietario. En cambio, se convierte en un proyecto open source independiente gestionado por una fundación, con financiamiento y soporte técnico continuo de OpenAI.

Sam Altman justificó este modelo en su post de X

Hidden Layer: La Ingeniería de OpenClaw

¿Por qué OpenClaw supera a los wrappers tradicionales? La clave está en su Runtime de Efectos Secundarios. No es solo orquestación; es persistencia.

// ANATOMÍA DEL RUNTIME DE OPENCLAW

1. The Loop (Ingestión):

// Middleware que normaliza inputs sucios (WhatsApp/Telegram)

// a esquemas JSON estrictos antes de tocar el LLM.

Input -> Structuring Layer -> Context Window

2. Agnostic Inference:

// Desacopla la lógica del proveedor.

// Permite routing inteligente: GPT-4 para razonamiento complejo,

// GLM-5 para tareas locales/privadas.

3. Cron Scheduler & Persistence (La Joya):

// El sistema no muere al cerrar la sesión.

// Gestiona colas asíncronas para tareas de larga duración.

// Ej: "Revisar disponibilidad de vuelos cada martes a las 3 AM".

4. Sandboxed Execution:

// El agente opera en un entorno confinado.

// Mitiga alucinaciones destructivas (ej: `rm -rf` en tu email).La diferencia clave vs competidores como LangChain o LlamaIndex es que OpenClaw está diseñado desde el inicio para end-users, no solo para developers: un usuario no técnico puede instalar OpenClaw, conectar su cuenta de OpenAI/Anthropic, y tener un asistente funcional en minutos.

Quantized News : {

HBM4: De la Spec al Silicio. Samsung ha roto el roadmap enviando las primeras unidades comerciales de HBM4 (11.7 Gbps, DRAM 1c). Para el CTO, esto deja de ser una proyección: la cadena de suministro que alimentará a las GPUs y TPUs de finales de 2026 ya tiene física real.

Adiós a GPT-4 (Ahora si). El 13 de febrero se ejecutó el apagado de la familia GPT-4 (4o, 4.1, mini). La consolidación hacia la arquitectura GPT-5.x elimina deuda técnica y promete mayor throughput. Si tu stack dependía de versiones legacy, hoy tienes un problema.

Code Editor = Agent OS. Con Microsoft actualizando el AI Toolkit y Google lanzando su Developer Knowledge API, el consenso es tácito: el IDE ya no es un editor de texto, es el sistema operativo donde viven y operan tus agentes a través del protocolo MCP.

};

Top Repos && Toolbox : {

GitHub Copilot SDK (Preview): Expone el CLI de Copilot programáticamente. Ideal para pipelines de CI/CD que se “auto-corrigen” sin intervención humana.

AI Toolkit for VS Code 0.30.0: Introduce depuración visual de tool calls. Básicamente, un “Wireshark para Agentes” que permite ver qué está pensando tu modelo en tiempo real.

Google Developer Knowledge API: Permite inyectar documentación oficial up-to-date en el contexto. Se acabó el scraping de documentación obsoleta para tus agentes.

Omnara (YC S25): Entornos remotos efímeros para ejecutar Claude Code. La promesa: delegar el cómputo pesado a la nube, permitiendo desarrollo de IA desde dispositivos ligeros.

};

Top Papers : {

1. DecompSSM: Time-Series Forecasting (arXiv:2602.05389) Una alternativa sólida al Transformer para series temporales. Propone tres ramas de State Space Models (SSM) en paralelo para capturar tendencia, estacionalidad y residuales.

Why it matters: Supera al SOTA en benchmarks (Weather, ETTm2) abandonando la descomposición manual. Es “End-to-End” real para datos temporales.

2. Mamba-360 Survey El mapa definitivo para entender cuándo usar arquitecturas SSM (Mamba, Hyena) frente a Transformers.

Takeaway: Si tienes restricciones de memoria o contextos infinitos, los SSMs son el camino. Si necesitas razonamiento generalista masivo, el Transformer sigue siendo el rey.

};

La convergencia entre el hardware rack-scale de NVIDIA y la orquestación federada de agentes (OpenClaw) define el nuevo baseline de la industria.

Mientras el mercado reacciona a la volatilidad de los anuncios, nosotros seguiremos monitoreando lo que importa: la eficiencia del cómputo y la robustez de la arquitectura.

Hasta la próxima compilación.

:: exit(0)